整體流程與核心概念

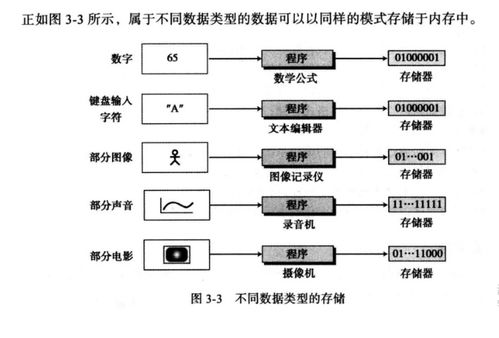

在數據科學項目中,數據存儲與計算是支撐整個數據價值鏈(從原始數據到業務洞察)的基礎設施層。一個典型的流程始于數據采集(如日志、傳感器、事務記錄),隨后數據進入存儲系統進行持久化。緊接著,通過計算框架對存儲的數據進行清洗、轉換、聚合與分析,最終結果可能被推送至應用層(如報表、API、機器學習模型)服務于決策或產品功能。理解這一線性流程是構建高效、可靠數據系統的第一步。

數據庫的選型:沒有銀彈

面對海量數據與多樣化需求,數據庫選型至關重要。核心考量維度包括:

- 數據結構:

- 關系型數據庫(如PostgreSQL, MySQL):適合結構化數據、需要復雜查詢、事務一致性(ACID)的場景,如核心業務系統。

- NoSQL數據庫:

- 文檔型(如MongoDB):適合半結構化、模式靈活的JSON數據。

- 鍵值型(如Redis):適合高速緩存、會話存儲等簡單讀寫場景。

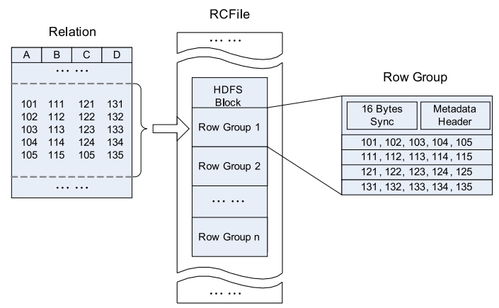

- 列式存儲(如Cassandra, HBase):適合大規模、高吞吐的寫入與聚合查詢(OLAP)。

- 圖數據庫(如Neo4j):擅長處理高度關聯的關系網絡數據。

- 讀寫模式:明確是以高并發寫入為主(如日志收集),還是以復雜分析查詢為主(如數據倉庫)。

- 擴展性:是否需要水平擴展(分片)以應對數據量增長。

- 一致性要求:在CAP定理中,根據業務在一致性(Consistency)、可用性(Availability)、分區容錯性(Partition Tolerance)之間的權衡進行選擇。

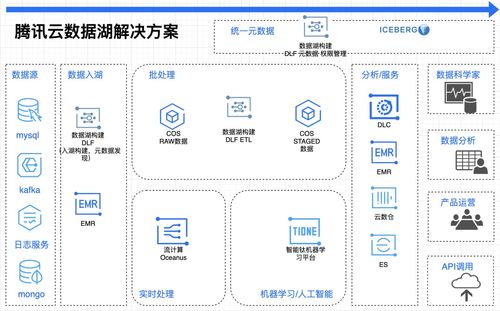

選型建議:現代數據架構常采用多模數據庫或混合架構,例如用關系型數據庫處理事務,用數據湖(如S3+Hive)存儲原始數據,再用列式數據庫(如ClickHouse)進行快速分析。

數據處理架構:Lambda vs. Kappa

這是兩種主流的流批一體化數據處理架構范式。

- Lambda架構:

- 核心思想:同時維護批處理層和速度層(流處理層)兩套計算邏輯。批處理層處理全量歷史數據,保證高準確性但延遲高;速度層處理實時增量數據,保證低延遲但可能犧牲一些準確性。兩者結果在服務層合并,對外提供統一的數據視圖。

- 優點:平衡了準確性與實時性。

- 缺點:需要維護兩套代碼和計算資源,系統復雜,運維成本高。

- Kappa架構:

- 核心思想:簡化架構,只保留流處理層。所有數據(無論歷史還是實時)都視為流,通過一個可重播的消息日志(如Apache Kafka)來存儲數據。當需要重新計算或糾正邏輯時,只需從日志中重新消費數據進行全量計算。

- 優點:架構單一,只需維護一套代碼;簡化了開發與運維。

- 挑戰:對消息隊列的存儲容量和回溯能力要求極高;流處理系統需要具備強大的狀態管理和精確一次(Exactly-Once)處理語義。

選擇建議:對于對實時性要求極高且邏輯相對穩定的場景,Kappa架構更簡潔高效。如果業務邏輯復雜且歷史數據的重新計算成本非常高,Lambda架構的批處理層仍具優勢。如今,隨著Flink等具備強大批流融合能力的計算引擎成熟,純粹的Kappa架構或混合架構成為新趨勢。

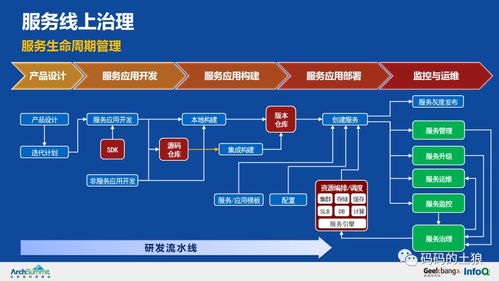

數據處理和存儲服務

云時代,大量托管服務極大降低了數據基礎設施的復雜度:

- 存儲服務:

- 對象存儲:如AWS S3、阿里云OSS,是構建數據湖的基石,成本低、無限擴展,適合存儲原始數據、非結構化數據。

- 托管數據庫:如Amazon RDS、Azure SQL Database、Google Cloud Spanner,提供自動備份、擴縮容等運維能力。

- 數據倉庫:如Snowflake、Amazon Redshift、Google BigQuery,專為大規模分析查詢優化,是數據分析的核心。

- 計算服務:

- 批處理:如AWS EMR(托管Hadoop/Spark)、Google Dataproc。

- 流處理:如AWS Kinesis、Google Dataflow、Azure Stream Analytics。

- 無服務器查詢:如AWS Athena(直接在S3上運行SQL),實現了存儲與計算的分離。

###

數據存儲與計算是數據科學的地基。從理解整體流程開始,根據數據特性和業務需求審慎選擇數據庫類型與處理架構,并積極利用現代化的云服務,可以構建出既敏捷又健壯的數據管線,為上層的數據分析與機器學習應用提供源源不斷的可靠燃料。在后續課程中,我們將深入數據清洗、分析與建模的具體實踐。