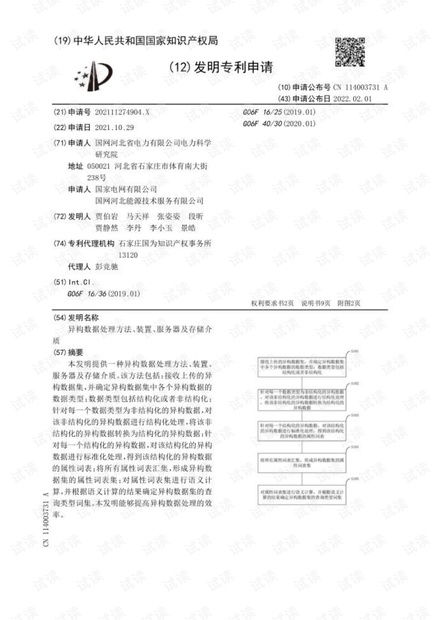

在大數據生態系統中,Apache Hive作為基于Hadoop的數據倉庫工具,扮演著至關重要的角色。它不僅提供了類似SQL的查詢語言(HiveQL),方便數據分析師進行數據查詢與分析,其高效的數據存儲格式與強大的數據處理能力更是其核心優勢。本文將系統性地介紹Hive的數據存儲格式、數據處理流程以及其在數據存儲服務中的定位。

一、 Hive數據存儲格式

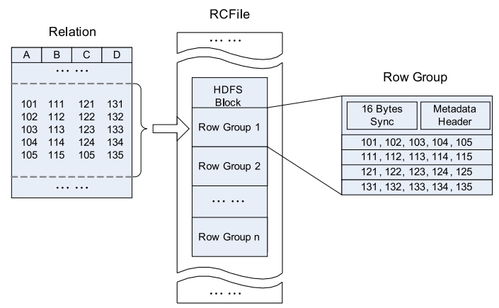

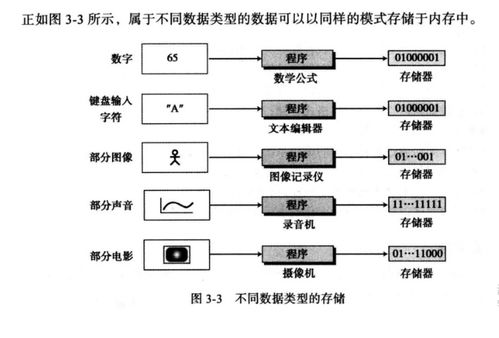

Hive的數據存儲格式直接決定了數據的讀寫效率、存儲空間利用率和查詢性能。Hive支持多種存儲格式,主要分為兩大類:行式存儲和列式存儲。

- 行式存儲格式

- 文本文件(TextFile):這是Hive默認的存儲格式。數據以純文本形式存儲,每行一條記錄,字段間通常由分隔符(如逗號、制表符)隔開。其優點是通用性強,人類可讀,易于與其他工具交換數據。缺點是存儲空間占用大,不支持塊壓縮,查詢效率較低,因為即使只查詢少數幾列,也需要讀取整行數據。

- SequenceFile:一種Hadoop生態系統中的二進制鍵值對存儲格式。它將數據序列化后存儲,支持塊壓縮,比TextFile更節省空間,且是Hadoop原生格式,兼容性好。但其本質上仍是行式存儲,對于需要全表掃描或只訪問部分列的分析查詢,效率提升有限。

2. 列式存儲格式

列式存儲將數據按列而非按行組織,特別適合數據分析場景,因為大多數分析查詢只涉及表中的部分列。

- ORC(Optimized Row Columnar):由Hive社區專門為Hive設計的高效列式存儲格式。它提供了極高的壓縮比(通過Run-Length Encoding、字典編碼等算法)和快速的讀取性能。ORC文件內部將數據劃分為Stripes(條帶),每個Stripe包含索引、數據行和footer。索引允許Hive快速跳過不相關的數據塊,極大地提高了查詢速度,尤其是帶謂詞(WHERE條件)的查詢。ORC是Hive場景下最推薦使用的格式之一。

- Parquet:另一種廣泛使用的、與語言和框架無關的列式存儲格式。它源自Google的Dremel論文,被Spark、Impala、Presto等多種大數據處理引擎原生支持。Parquet支持復雜的嵌套數據結構,并具有優秀的壓縮和編碼方案。在Hive與Spark等組件共存的混合環境中,Parquet因其出色的跨平臺兼容性而成為理想選擇。

選擇建議:對于ETL過程中的中間臨時表或需要頻繁全字段訪問的場景,可考慮行式存儲。而對于數倉中的核心事實表、維度表,進行大規模分析查詢時,強烈推薦使用ORC或Parquet格式。

二、 Hive數據處理流程

Hive的數據處理并非在自身進程中完成,其本質是一個“翻譯器”和“協調者”。

- 解析與編譯:用戶提交HiveQL語句(如SELECT, JOIN, GROUP BY)。Hive的Driver組件首先對SQL進行解析(Parse),生成抽象語法樹(AST)。然后進行語義分析和編譯(Compile),將AST轉換為一系列的邏輯操作(邏輯執行計劃)。

- 優化:優化器(Optimizer)對邏輯執行計劃進行優化,例如謂詞下推、列裁剪、分區裁剪等。優化的核心思想是盡可能早地過濾掉無關數據,減少后續階段需要處理的數據量。例如,對于列式存儲,優化器會確保只讀取查詢涉及的列。

- 執行計劃生成:優化后的邏輯計劃被轉換成物理執行計劃,即一系列由MapReduce、Tez或Spark任務組成的DAG(有向無環圖)。Hive早期默認使用MapReduce,但其Tez或Spark on Hive引擎因更優的內存管理和DAG執行模型,能提供更低的延遲和更高的吞吐量。

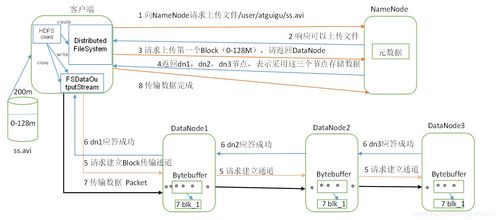

- 任務執行與結果返回:Hive將物理執行計劃提交給底層的計算引擎(如YARN上的Tez/Spark)。計算引擎調度任務在Hadoop集群上執行,從HDFS讀取數據,經過Map、Shuffle、Reduce等階段處理,最終將結果寫回HDFS或直接返回給客戶端。

整個流程體現了Hive“讀時模式”(Schema-on-Read)的特點:數據存儲時無需嚴格定義格式,在查詢時根據表定義進行解析,提供了極大的靈活性。

三、 Hive作為數據存儲與處理服務

在企業的數據架構中,Hive通常定位為中心化的數據倉庫存儲與批量處理服務。

- 存儲服務角色:Hive的表數據實際存儲在HDFS上,Hive Metastore(元數據存儲,通常使用MySQL等關系數據庫)則集中管理所有表的元信息(如表名、列名、數據類型、分區信息、數據存儲路徑等)。這使得多個用戶和計算引擎(如Spark、Presto)可以通過統一的元數據視圖訪問和共享同一份數據,避免了數據孤島。Hive Metastore是Hadoop生態中許多組件共享元數據的事實標準。

- 處理服務角色:Hive提供了穩定、可靠的批量SQL處理能力。它擅長處理TB/PB級別的歷史數據離線分析、復雜的ETL作業(數據清洗、轉換、加載)、定期報表生成等場景。雖然其基于磁盤的批處理模式導致延遲較高(分鐘到小時級),不適合實時查詢,但其吞吐量高、容錯性強、成本低廉的優勢在離線分析領域無可替代。

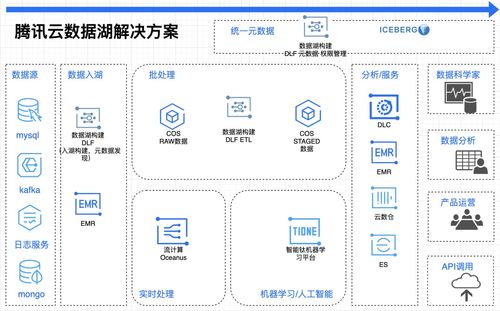

- 服務化集成:在現代數據平臺中,Hive常作為底層存儲與計算層,與調度系統(如Airflow、DolphinScheduler)、數據湖框架(如Hudi、Iceberg)、即席查詢引擎(如Presto, Impala)以及BI工具(如Tableau, Superset)緊密集成,共同構成完整的數據服務棧。

Hive通過其靈活多樣的數據存儲格式(尤其是高效的列式格式ORC/Parquet)、將SQL翻譯為分布式任務的強大處理能力,以及作為中心化元數據樞紐的服務定位,構建了一個成熟、穩定、高性價比的企業級數據倉庫解決方案,是大數據時代不可或缺的核心組件之一。